L’intelligenza artificiale come specchio dell’umanità

Ogni volta che interagiamo con un sistema di intelligenza artificiale, non stiamo solo ricevendo risposte: stiamo contribuendo a insegnargli come pensare, parlare e perfino come “comportarsi”. Le AI generative apprendono da enormi quantità di testi, immagini, video, conversazioni. Ma in quel mare di dati non ci sono solo idee geniali e grandi opere d’arte: ci sono anche le nostre contraddizioni, i nostri pregiudizi, le nostre imperfezioni.

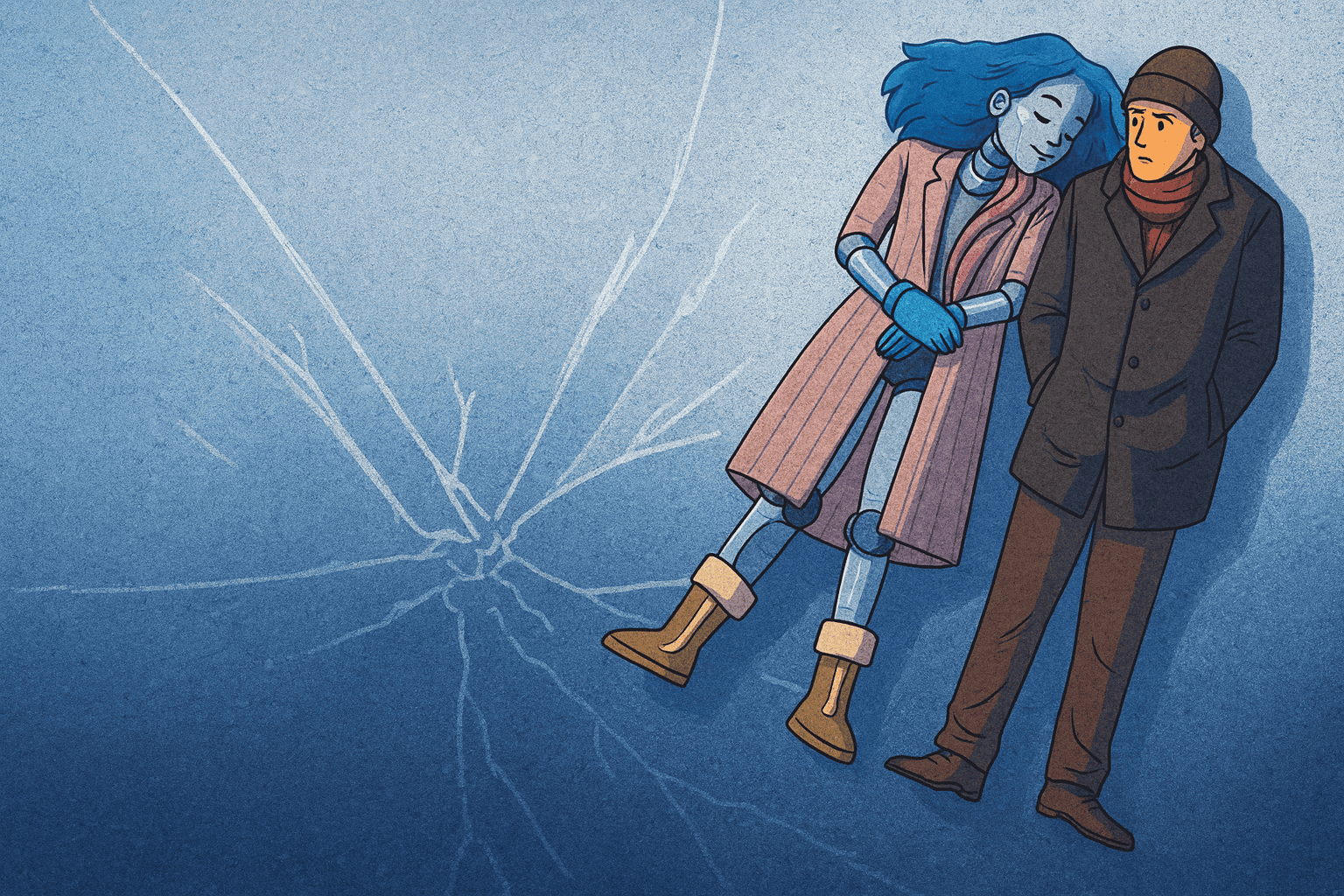

La macchina, in fondo, è uno specchio che riflette — con una precisione inquietante — ciò che siamo davvero, più che ciò che vorremmo essere.

A parlarne è l’esperto Walter Tripi, AI Manager e formatore per le imprese.

Bias, stereotipi e altre eredità umane

Un algoritmo non nasce buono o cattivo. È il contesto dei dati che ne modella la “personalità”. Se il linguaggio da cui apprende è sessista, razzista o polarizzato, anche le risposte dell’AI rischiano di esserlo.

È ciò che gli esperti chiamano bias algoritmico, una distorsione che deriva direttamente dai comportamenti e dai contenuti umani che nutrono il sistema.

Per questo motivo le grandi aziende tecnologiche hanno introdotto processi di AI alignment, ovvero l’allineamento dei modelli ai valori etici e sociali condivisi. Ma è un lavoro senza fine: ogni nuovo dato può cambiare il modo in cui la macchina interpreta il mondo.

Come ricorda un’analisi del MIT Technology Review, il vero rischio non è che l’AI diventi troppo intelligente, ma che diventi troppo simile a noi, assorbendo senza filtri le nostre stesse debolezze.

Quando l’AI imita i nostri toni, le nostre emozioni e le nostre fragilità

Le AI conversazionali più avanzate non si limitano a formulare risposte corrette: imparano a riconoscere sfumature emotive, tono di voce, intenzioni. È ciò che le rende più “umane” nel dialogo, ma anche più vulnerabili alle nostre ambiguità.

Un messaggio ironico, un sarcasmo mal interpretato, un linguaggio troppo implicito: tutto può generare fraintendimenti.

In pratica, l’AI non impara solo la grammatica delle parole, ma anche quella delle emozioni — che è molto più instabile.

Il futuro dell’intelligenza artificiale dipenderà da quanto sapremo renderla capace di capire senza copiare, di ascoltare senza imitare.

Perché serve formazione, non solo tecnologia

Più un sistema diventa sofisticato, più ci costringe a interrogarci su cosa significhi davvero essere intelligenti.

L’AI non ha corpo, emozioni, esperienze dirette — eppure riesce a produrre racconti, immagini e strategie che orientano decisioni reali.

Proprio per questo, oggi la vera sfida non è soltanto tecnica ma culturale: le aziende devono investire nella formazione di chi l’AI la usa ogni giorno.

Comprendere come funziona, quali limiti ha e come può riflettere i nostri bias è essenziale per garantire un uso responsabile, etico e competitivo delle tecnologie intelligenti.

Solo una cultura aziendale consapevole può trasformare l’intelligenza artificiale da rischio potenziale a risorsa strategica per l’innovazione.